今話題のDeepSeek R1をMacで手軽に利用したいので「Ollama」と呼ばれるローカル環境で自然言語処理(LLM)を実行できるオープンソースソフトウェアを導入します

DeepSeekについては、公式のアプリケーションにはプライバシーに関する懸念があるため、オフラインでも利用可能なOllamaを使用し、安全にLLMを活用することにします。

Ollama

以下のリンクをクリックしてダウンロードページに移動します

「Download for macOS」をクリックします

「Move to Applications」をクリックします

「Next」をクリックします

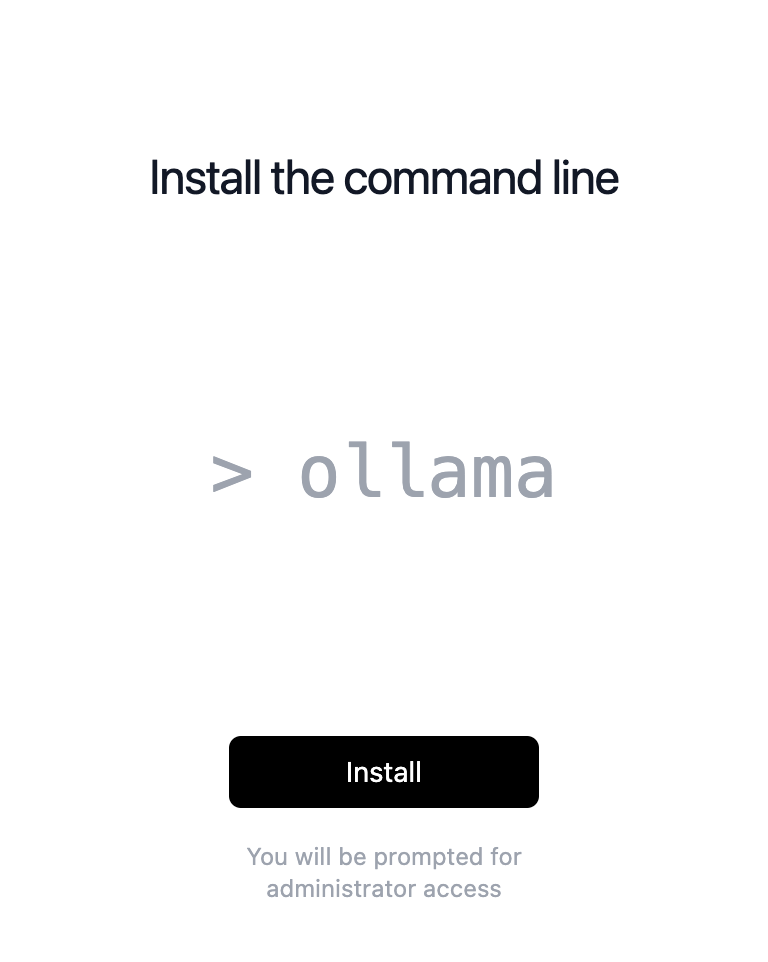

「Install」をクリックします

「Touch ID」かパスワードを使用をしてインストールを許可してください

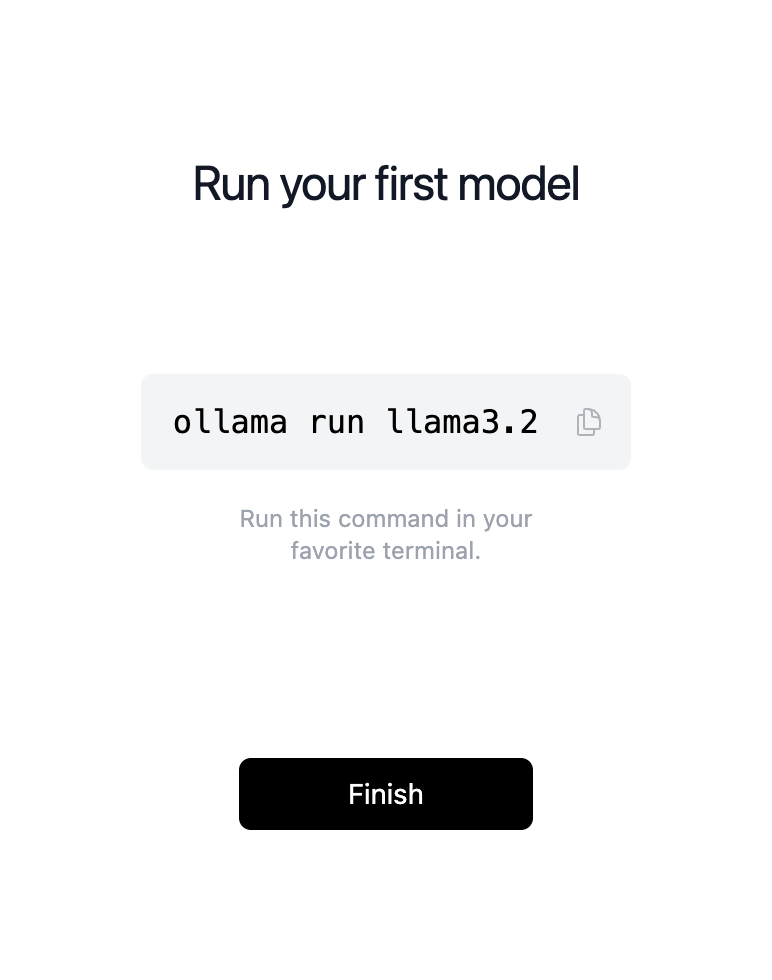

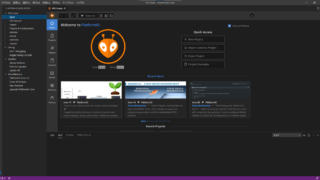

以下の画面が出ればインストール成功です

「Finish」をクリックします

DeepSeek R1

今回は、CyberAgentが本家DeepSeekに日本語データで追加学習を行ったLLMを公開しているのでこちらをベースに使いますが、Ollamaに直接的に使えないのでOllamaで使えるように変換されたモデルを利用します

ターミナルを開く

「LaunchPad」>「その他」>「ターミナル」をクリックして黒い画面を起動します

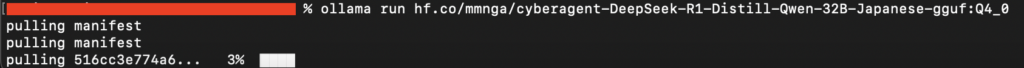

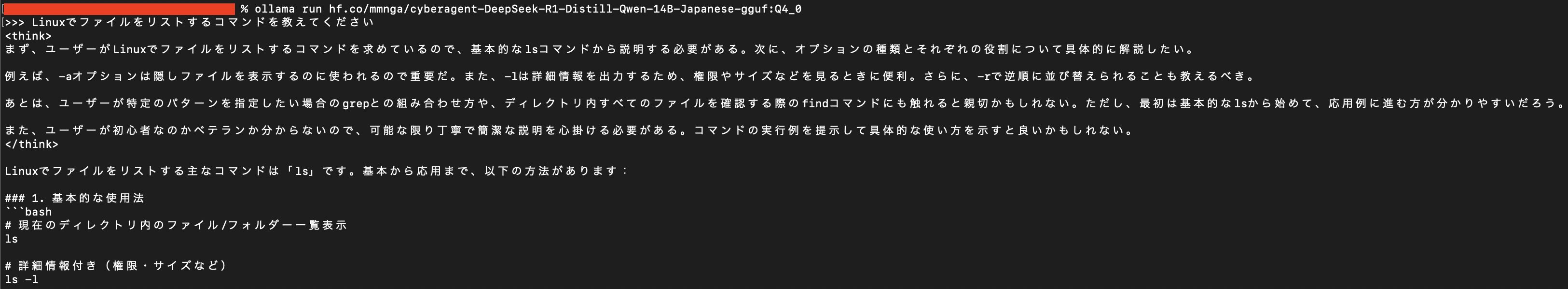

以下のコマンドをコピー&ペーストして「Enterキー」をクリックします

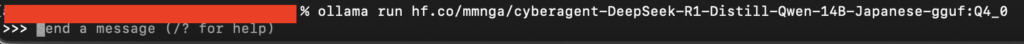

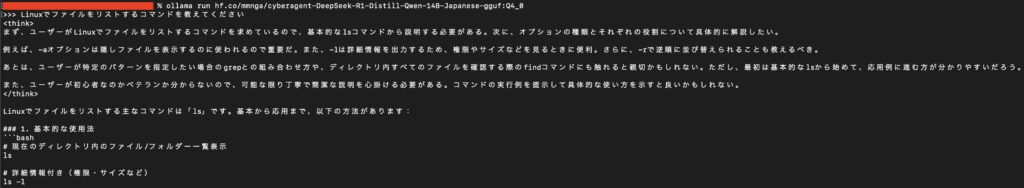

ollama run hf.co/mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese-gguf:Q4_0以下はターミナルで同じコマンドを実行した結果です

このように「>>>」が出てきたら準備完了です

以下の質問をしましたが想定通りですね〜

モデル削除

Ollamaで不要になったモデルを放置していると容量を圧迫するのでモデルを削除する方法を紹介いたします。

以下のコマンドを実行するとモデルの一覧が表示されます

ollama ls以下のように表示されます

NAME ID SIZE MODIFIED

hf.co/mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-32B-Japanese-gguf:Q4_0 30c6d97da60d 18 GB 4 minutes agoモデルを削除する場合は、NAMEにある要素をコピーして以下のコマンド実行します

ollama rm <NAME>NAMEが「hf.co/mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-32B-Japanese-gguf:Q4_0」であれば、

ollama rm hf.co/mmnga/cyberagent-DeepSeek-R1-Distill-Qwen-14B-Japanese-gguf:Q4_0でモデルを削除することができます

コメント